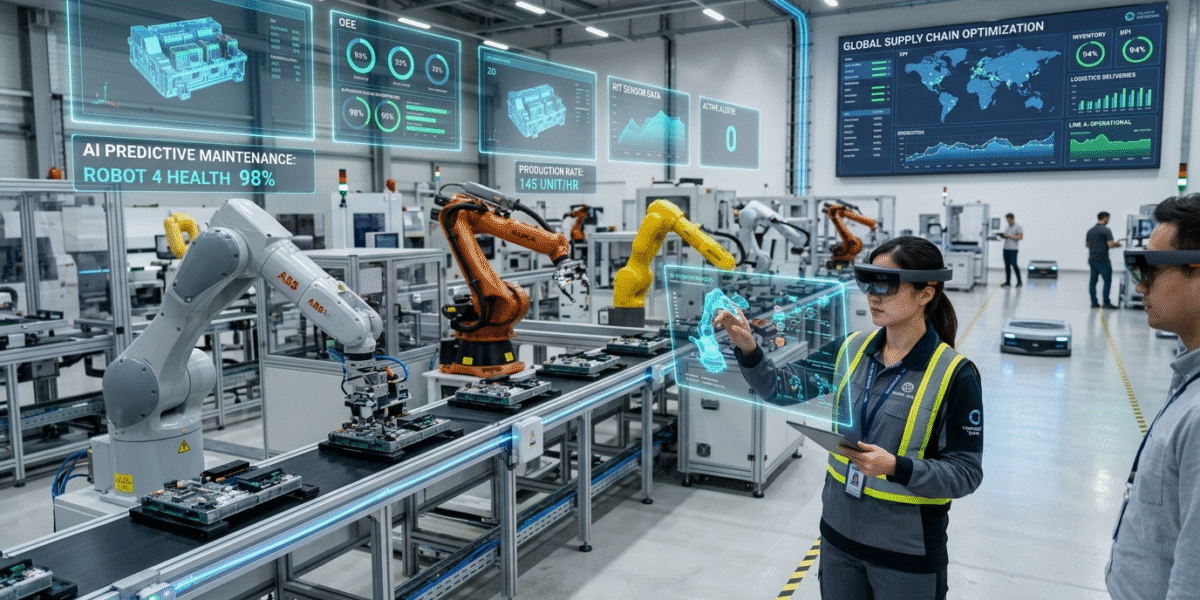

Comment l’usine intelligente inspire les expériences numériques

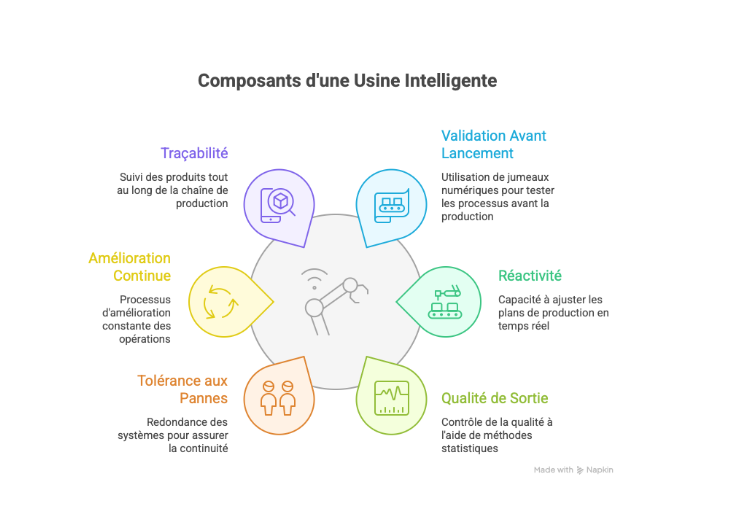

Dans l’industrie de pointe, la qualité se gagne avant le premier boulon ; dans le numérique, la confiance naît avant le premier clic. Ce miroir renvoie la même exigence. Capteurs, IA, jumeaux numériques et ergonomie guident autant l’usine que les plateformes, y compris les univers ludiques, tel un casino en ligne en france conçu avec une rigueur d’ingénieur et une finesse de designer.

Les spécialistes notent que trois convergences pratiques sautent aux yeux. D’abord, le test en environnement virtuel : la 3D-impression valide un prototype comme une plateforme évalue une interface via un jumeau d’usage. Ensuite, la robotique et la cybersécurité partagent le réflexe de tolérance aux pannes. Enfin, la science des matériaux inspire la scénographie numérique : ce que la main ressent dans un alliage, l’œil et l’oreille doivent le pressentir dans une interface.

Robots, algorithmes et joueurs : même exigence de fiabilitéLa fiabilité se conçoit et se prouve.

Robots et plateformes l’atteignent par redondance, contrôle et retour d’expérience mesuré. Cette vérité vaut pour le bras cobot qui répète un geste comme pour le serveur qui gère une vague d’utilisateurs.

Dans un atelier automatisé, chaque action critique a un capteur en sentinelle. Entre-temps, sur une plateforme ludique, chaque transaction est soumise à des contrôles d’intégrité. Les ingénieurs parlent de chaînes de confiance : un signal n’avance que s’il est attesté par ses pairs, un flux n’est validé que s’il porte les métadonnées attendues. Cette architecture responsabilise chaque étage du système.

La pratique montre que la redondance intelligente bat la duplication brute. Dans la robotique, deux caméras d’angles différents remplacent avantageusement une unique caméra « parfaite ». Même logique côté services numériques : un cluster de micro-services indépendants, observables et rapidement remplaçables résiste mieux qu’un monolithe massif. Et pourtant, le public ne perçoit rien d’autre qu’une fluidité sans couture.

Selon l’expérience des collègues, la tolérance aux pannes doit être proactive. Un cobot ralentit quand la vibration sort de plage, plutôt que d’attendre la panne. De façon analogue, une plateforme réduit automatiquement la charge d’une région serveur lorsque la latence grimpe. Cette « souplesse nerveuse » sépare les infrastructures robustes des autres.

Honnêtement, la culture d’essai-erreur fait la différence. Les ateliers d’assemblage pratiquent le Poka-Yoké, l’anti-erreur par design, tandis que les produits numériques intègrent des garde-fous de parcours évitant les clics irréversibles. Les deux mondes partagent le même mantra : l’erreur doit être peu probable, vite détectée et sans conséquence majeure.

Du jumeau numérique aux simulateurs de trafic

Un jumeau numérique permet de tester sans casser. Les simulateurs de trafic et d’usage jouent le même rôle pour les plateformes. Il s’agit de dérisquer tôt, puis d’itérer vite, sans peur d’apprendre.

Les ingénieurs de production modélisent une ligne, insèrent des avatars de robots, injectent des tolérances, puis observent le débit. De leur côté, les architectes numériques génèrent des cohortes d’utilisateurs simulés, mesurent la latence, les erreurs rares, l’équité d’un algorithme, et corrigent. Entre les deux gît un même geste : faire transpirer le système avant le premier client.

La simulation a un corollaire : la traçabilité. Dans un atelier, chaque lot garde l’empreinte de ses paramètres. Sur une plateforme, chaque session conserve l’ombre de ses timings et décisions serveur. Les spécialistes notent que cette mémoire, si elle est sobrement conservée et anonymisée, devient une boussole d’optimisation continue.

D’ailleurs, la visualisation compte. Un mur d’atelier orchestre cadences, en-cours et alertes, comme un tableau de bord d’exploitation expose taux d’erreur, pics de charge et santé des micro-services. L’œil humain capte les motifs bien avant que l’algorithme n’explique tout ; c’est là que l’expérience pèse lourd.

Pour éclairer ces parallèles, voici un tableau de correspondances opérationnelles entre usine intelligente et plateforme en ligne :

| Capacité clé | Usine intelligente | Plateforme en ligne | Indicateur commun |

| Validation avant lancement | Jumeau numérique de ligne | Test de charge et canari | Taux d’échec pré‑prod |

| Réactivité | Replanification de tâches | Autoscaling des pods | Temps de reprise |

| Qualité de sortie | Contrôle statistique (SPC) | Monitoring de SLO | Variance contrôlée |

| Tolérance aux pannes | Redondance robot/capteur | Routage et retry | Taux d’incident |

| Amélioration continue | Kaizen / A3 | Post‑mortem sans blâme | Actions clôturées |

| Traçabilité | Lot et généalogie pièce | Logs et corrélation | Couverture d’audit |

Matériaux avancés, UX tactile et micro-latences

La matière enseigne l’ergonomie. L’UX numérique hérite de cette sensibilité via la latence, le contraste, le son et les micro-animations. Ce qui est agréable à toucher doit aussi être agréable à cliquer.

Dans les laboratoires de nouveaux matériaux, la sensation se mesure : dureté, rugosité, amortissement. Entre-temps, côté interfaces, les micro-latences font office de texture invisible. Une réponse à 50 millisecondes paraît « élastique », une à 200 semble « spongieuse ». Les spécialistes recommandent de traiter la latence comme un matériau, avec ses tolérances et sa tenue dans le temps.

L’impression 3D offre une liberté de formes utiles. Il en va de même pour la mise en page adaptative, où des composants réutilisables et des thèmes cohérents composent une « charpente » solide. La logique d’assemblage modulaire en atelier a sa sœur jumelle dans le design système : petites pièces robustes, interfaces claires, assemblage rapide, démontage sans casse.

La couleur et le son complètent l’illusion de matière. Un alliage sonne différemment selon sa composition ; une interface rassure différemment selon ses tons et ses clics. L’oreille humaine débusque l’artifice. D’où l’intérêt d’échantillons A/B mesurés comme le ferait un métallurgiste : on écoute, on compare, on choisit, puis on documente.

Et si l’on songe aux expériences ludiques, l’éclairage n’est pas que décor. Des contrastes calibrés guident l’attention, des animations donnent le tempo, telle une chaîne de convoyeurs rythmiques. Les retours haptiques sur mobile, réglés comme un amortisseur, comblent l’écart entre artifice et présence.

Chaînes d’approvisionnement et pipelines de données

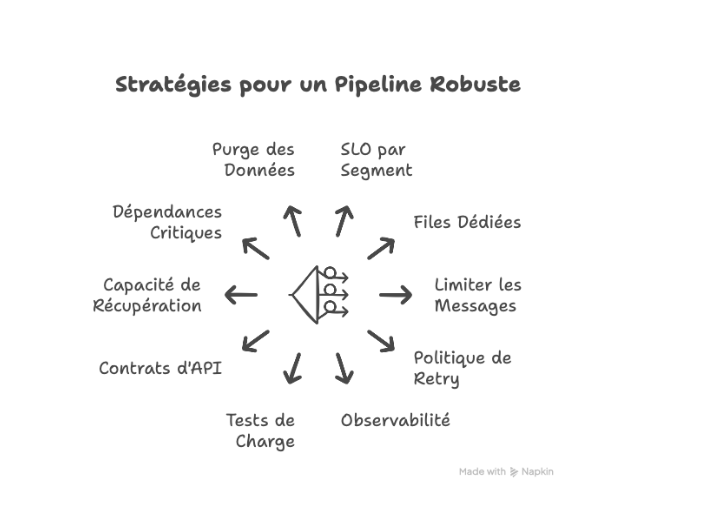

Une chaîne d’approvisionnement performante inspire un pipeline de données fiable. Dans les deux cas, on parle de flux, de goulots, de stocks tampons et de délais garantis.

La logistique industrielle traite des pièces, des délais, des marges d’erreur ; les architectures numériques traitent des événements, des files et du back-pressure. Les praticiens décrivent un même jeu : limiter la variabilité à l’entrée, absorber les pics et lisser la sortie. Un court tampon bien placé vaut mieux qu’un grand stock inerte.

Entre-temps, la visibilité de bout en bout rassure. Un ERP cartographie fournisseurs et lots ; un graphe d’observabilité relie services et dépendances. Cette transparence réduit les délais de diagnostic, améliore les prévisions et évite les contresens locaux qui sabotent la performance globale.

La discipline du juste-à-temps inspire le « juste-à-données » : point trop n’en faut. Les flux légers et compressés économisent réseau et énergie. Les spécialistes notent que la sobriété technique n’est pas une coquetterie ; elle multiplie la résilience, abaisse les coûts et rend les anomalies plus visibles. Moins de bruit, plus de signal.

Pour clarifier les priorités d’un pipeline robuste, voici une liste pratique que les équipes gardent sous la main :

- Définir des SLO par segment de flux et non globalement.

- Isoler les goulots par des files dédiées à capacité bornée.

- Limiter la taille des messages et normaliser les schémas.

- Mettre en place une politique de retry avec backoff et circuit breaker.

- Garantir l’observabilité : métriques, logs corrélés, traces distribuées.

- Automatiser les tests de charge avec des scénarios de pics réalistes.

- Mettre à jour et vérifier les contrats d’API comme on audite un fournisseur.

- Entretenir une « capacité de récupération » réservée aux incidents majeurs.

- Documenter les dépendances critiques et les chemins de dégradation gracieux.

- Planifier la purge et l’archivage afin d’éviter la dette de données.

Sécurité fonctionnelle et jeu responsable

La sécurité se pense dès la conception. Les plateformes ajoutent la dimension du jeu responsable : prévenir l’abus, protéger, expliquer. L’ingénierie et l’éthique se parlent.

En robotique, la sécurité fonctionnelle impose des « arrêts sûrs », des zones protégées, des vitesses réduites à proximité humaine. Côté services ludiques, la sécurité s’adosse à des algorithmes d’authentification renforcés, au chiffrement des canaux et à des contrôles d’intégrité des transactions. Les deux univers privilégient l’anticipation sur la réaction.

Les spécialistes rappellent qu’un système sûr est un système compréhensible. Les interfaces doivent expliquer les décisions critiques : pourquoi une opération est refusée, pourquoi une limite s’applique. L’analogie avec un voyant d’atelier est éclairante : l’alerte n’est utile que si la personne sait quoi faire ensuite.

Le jeu responsable ajoute des garde-fous humains au-delà des mécanismes techniques. Cela inclut des limites paramétrables, des notifications claires, des pauses suggérées et la possibilité d’exclure volontairement des fonctionnalités. Entre-temps, l’usine moderne adopte des « permis de tâche », des check-lists partagées et des formations régulières, qui jouent le même rôle protecteur.

Enfin, la supervision doit être bienveillante et documentée. Les plans d’intervention, les audits, les tests d’intrusion, les exercices de reprise, tout cela s’inscrit dans un cycle d’amélioration continue. Le but n’est pas de blâmer, mais d’apprendre, corriger et prévenir, à la manière d’une cellule qualité.

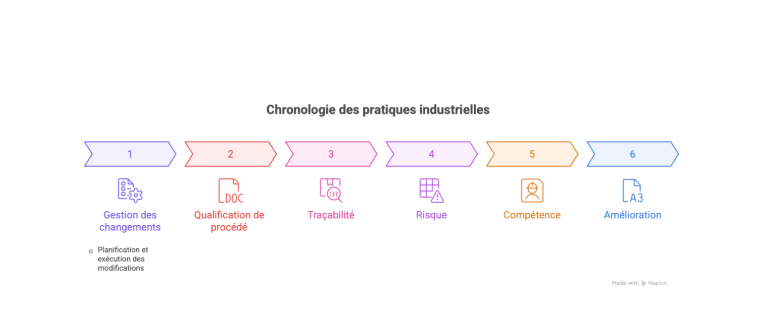

Normalisation, conformité et audit continu

Les normes stabilisent le progrès. L’audit les rend vivantes, pas poussiéreuses. Sans elles, l’excellence n’est pas reproductible.

Dans les ateliers avancés, des référentiels de qualité encadrent la traçabilité, la qualification des procédés et la gestion des changements. Dans le numérique, des cadres équivalents guident la gestion des risques, la protection des données et la sécurité des développements. Les spécialistes notent que la normalisation sert la créativité en bornant l’aléatoire néfaste.

Entre-temps, l’audit évolue : il devient continu. Plutôt que d’attendre une revue ponctuelle, des contrôles automatisés vérifient des propriétés à chaque modification. L’analogie avec le contrôle statistique de procédé est directe : on guette un écart de dérive bien avant la non-conformité éclatante.

La cartographie des obligations reste délicate, car elle traverse technique, juridique et humain. Une bonne pratique consiste à traduire chaque exigence en scénario vérifiable, avec propriétaire, métrique et seuil. Les équipes gagnent en sérénité lorsque l’exigence cesse d’être abstraite pour devenir un test reproductible.

Pour rendre cette mécanique tangible, un tableau d’alignement entre pratiques industrielles et numériques aide à répartir les rôles :

| Domaine | Pratique industrielle | Pratique numérique | Évidence d’audit |

| Gestion des changements | Ordres de modification (ECO) | Pull request avec revue | Journal signé |

| Qualification de procédé | Plans de validation (IQ/OQ/PQ) | Tests unitaires/intégration | Rapports automatiques |

| Traçabilité | Généalogie des lots | Traces distribuées | Corrélation horodatée |

| Risque | AMDEC procédé/produit | Analyse de menaces | Plan de mitigation |

| Compétence | Habilitations opérateurs | Accès à privilèges | Registre d’accès |

| Amélioration | Résolution A3 | Post‑mortem ouvert | Actions suivies |

IA d’optimisation : maintenance prédictive et personnalisation

L’IA oriente sans remplacer le jugement. Elle prédit des pannes et anticipe des besoins. Bien entraînée, elle amplifie l’expertise, elle ne la dissout pas.

La maintenance prédictive, nourrie des signaux de vibration, de température et de courant, avertit avant la casse. Entre-temps, la personnalisation d’une plateforme détecte des préférences, ajuste des parcours, propose des expériences mieux calibrées. Les deux partagent le même socle d’apprentissage supervisé, de features propres et d’étiquettes fiables.

Les spécialistes insistent sur l’hygiène des données. Sans échantillons représentatifs, l’IA devient une loupe déformante. L’équilibrage de classes rares, la détection de dérive, la validation hors échantillon sont des gestes de base, aussi essentiels que le graissage d’un palier ou l’étalonnage d’un capteur.

Et puis, il y a l’explicabilité. Dans l’atelier, un technicien doit comprendre pourquoi une pompe est jugée « à risque ». Sur une plateforme, un utilisateur et une équipe conformité doivent saisir la logique d’une recommandation. Graphes de dépendances, scores de contribution, règles dérivées : autant d’outils qui rendent l’IA discutable, donc améliorable.

Pour opérationnaliser cette IA modeste mais efficace, voici une feuille de route concrète à large spectre :

Définir la question utile : panne à prédire, métrique à optimiser, comportement à expliquer.

Cartographier les sources de données, leurs propriétaires et leurs fréquences d’actualisation.

Nettoyer, anonymiser, échantillonner de façon stratifiée les événements rares.

Construire des features stables, liées à des phénomènes causaux, pas seulement corrélés.

Valider hors période et sous des scénarios adverses pour éviter l’auto-complaisance.

Déployer en « ombre » avant action, pour collecter des contre-factuels en sécurité.

Installer une boucle MLOps : monitoring des dérives, ré-entraînement, rollback.

Prévoir une UI d’explicabilité adaptée au destinataire, du technicien à la conformité.

Calculer le ROI avec prudence : gains, coûts d’inférence, dettes de maintenance.

Documenter les limites : domaines de validité, incertitudes, devoir d’alerte humaine.

De la salle blanche à la salle virtuelle : leçons croisées

Les rituels d’excellence voyagent. Ce qu’une salle blanche impose à un opérateur, une salle virtuelle l’exige d’un service : calme, propreté, méthode. La discipline sert l’enchantement.

Dans l’aéronautique, chaque écrou trouve sa place, chaque geste son gabarit. Entre-temps, sur une plateforme, chaque composant UI a sa charte, chaque flux sa politique de tolérance. L’esthétique est fille de la contrainte bien acceptée : on simplifie, on range, on respire. Les spécialistes aiment rappeler qu’un système lisible se répare vite.

Entre autres parallèles, la notion de « premier passage bon » inspire l’expérience initiale. L’utilisateur doit réussir sa première action comme une pièce doit franchir d’un coup le contrôle qualité. Des micro-guidages, des exemples pré-remplis, des seuils de validation immédiats jouent le rôle des gabarits et piges de contrôle en atelier.

Et pourtant, l’imprévu existe. Une salle virtuelle doit absorber l’exception sans panique : parcours de secours, messages clairs, reprise d’état. La résilience apparente est souvent un montage délicat de décisions minuscules, comme la redondance discrète d’un capteur critique ou d’un lien réseau caché.

Enfin, le « cleanroom mindset » inspire une hygiène de code et de données. Variables nommées, schémas versionnés, secrets protégés, environnements isolés. Ce qui se salit se nettoie, ce qui se mêle se sépare, ce qui se brise se remplace. L’élégance technique a le parfum des ateliers impeccables.

Monétisation, équité perçue et métrologie de la confiance

La valeur naît quand la confiance persiste. Sans métriques de confiance, la monétisation s’épuise ou devient suspecte. On mesure d’abord, on ajuste ensuite.

Dans la production avancée, la métrologie garantit dimensions et performances. Côté services numériques, une métrologie de la confiance suit disponibilité, transparence, équité perçue, satisfaction et effort utilisateur. Les spécialistes conseillent d’investir dans ces indicateurs « mous », car ils gouvernent les comportements « durs » : rétention, bouche-à-oreille, recommandations.

L’équité perçue est un ressort puissant. En atelier, deux opérateurs acceptent une contrainte si la règle est claire et symétrique. Sur une plateforme, les règles d’usage et de service doivent être lisibles et stables. Quand la règle change, l’explication précède l’application. C’est contraignant, certes, mais durable.

Entre-temps, la monétisation responsable ressemble à la gestion des stocks : on évite l’excès qui coûte, on évite la rupture qui frustre. Les paliers, remises et bonus doivent être expliqués comme un bon de livraison : quoi, quand, comment et pourquoi. La confiance se gagne à coups de précisions.

- Pour donner du relief à cette discipline, une grille d’indicateurs concrets aide les équipes à piloter la relation :

- Taux de compréhension des règles clés, mesuré par sondage en contexte.

- Délai moyen d’explication lors d’un changement de politique.

- Part de décisions « réversibles » offertes par défaut à l’utilisateur.

- Temps de résolution des incidents, accompagné d’un compte rendu public.

- Taux d’adhésion aux limites configurables et d’usage du mode pause.

- Indice d’effort perçu pour atteindre une action souhaitée.

- Variabilité de performance en heure de pointe vs heure creuse.

- Densité d’informations utiles par écran, sans surcharge cognitive.

- Transparence de la tarification et cohérence des avantages.

- Clarté des chemins de recours en cas de désaccord.

Fabrication additive, spatial et scénarios extrêmes côté plateforme

Les conditions extrêmes révèlent la vérité d’un système. L’espace forge cette culture. Les plateformes s’en inspirent pour survivre aux pics et aux pannes rares.

Dans les missions orbitales, chaque gramme compte et chaque watt se justifie. Entre-temps, une architecture numérique durable s’allège de toute redondance inutile, préfère l’edge computing pour réduire la latence et limite les transferts bavards. Les ingénieurs parlent d’élégance fonctionnelle : le juste nécessaire, posé au bon endroit.

La fabrication additive apprend à penser « fonction » avant « forme » : nervures internes, topologies organiques, masse orientée. Côté services, cela devient séparation des préoccupations, limites d’API claires et choix de formats adaptés à l’usage. Une requête ne doit pas porter plus que son destinataire ne peut digérer.

Les scénarios extrêmes — afflux massif, coupure régionale, panne du fournisseur — s’exercent comme des simulations d’anomalies en microgravité. Jeux de rôle, journaux inclinés, coupure volontaire de dépendances : tout s’apprend. Les spécialistes recommandent de ritualiser ces exercices afin qu’ils cessent d’être exceptionnels et deviennent une musculature réflexe.

Enfin, la récupération importe plus que l’infaillibilité. L’espace enseigne la dégradation gracieuse : on coupe des fonctions non vitales, on garde l’essentiel. Une plateforme bien pensée sait quoi sacrifier pour préserver l’expérience de base. La sophistication réelle se voit surtout dans la simplicité maintenue, même au pire moment.

Ateliers d’ergonomie : transposer la précision matérielle au virtuel

La précision ergonomique se prototype. Les ateliers la pratiquent, les studios numériques la reprennent. Un bon geste vaut mille explications.

En poste d’usinage, l’accessibilité et la hauteur évitent les erreurs et l’épuisement. En interface, la hiérarchie visuelle, la taille des zones actives, la prévisibilité des gestes réduisent l’effort. Les spécialistes recommandent de concevoir « à la main » avant l’écran : scénarios joués, gestes mimés, contraintes simulées.

Entre-temps, l’essai utilisateur reprend la logique d’un contrôle géométrique : tolérances, points de mesure, critères d’acceptation. Des cycles courts, des hypothèses claires, des décisions tranchées. Une poignée de bons tests vaut mieux qu’une grande masse mal ciblée. Le savoir-faire consiste à choisir les bons angles de mesure.

Le son, souvent négligé, apporte une précision affective. Un clic trop sec devient anxiogène ; un clic trop mou manque d’engagement. Dans les ateliers, l’oreille apprend à lire la santé d’un outil. Sur une plateforme, elle ressent l’intention du produit. Entre le marteau et le pixel, la musique change, la logique reste.

Dernier détail, pas si petit : l’accessibilité inclusive. Comme un outil se choisit pour des mains différentes, une interface anticipe contrastes, navigation clavier, lecteurs d’écran, sous-titres, vitesses ajustables. Ce qui aide une minorité aide la majorité. C’est souvent là que le soin se voit.

Cadences, énergie et sobriété calculée

Produire bien, c’est produire au rythme juste. Les plateformes apprennent la même musique. La sobriété n’est pas une mode : c’est une technique.

Les ateliers règlent les vitesses d’avance, les profondeurs de passe, les pauses de refroidissement. En services numériques, on calibre la fréquence d’actualisation, la compression adaptative, les mises en cache locales. Les spécialistes rappellent que la meilleure optimisation est celle qu’on ne paie plus : éliminer l’inutile plutôt que sublimer le superflu.

Entre-temps, l’énergie devient métrique de pilotage. Un algorithme plus sobre, un codec mieux choisi, une latence réduite à la source économisent des watts qui s’additionnent. Les tableaux de bord gagnent à inclure des coûts énergétiques, pas seulement des coûts cloud. La facture révèle souvent des redondances qui attendent d’être simplifiées.

Le cycle de vie complet compte : conception, déploiement, exploitation, retrait. Comme une machine trouve une seconde vie après rétrofit, un composant logiciel peut connaître une refactorisation salvatrice, avec à la clé moins de dette, plus de clarté et des performances qui cessent d’onduler.

Au total, la cadence idéale est celle qui maximise la sérénité du système. Ni trop vite, ni trop lentement. Un balancier juste rend tout plus stable : opérateurs moins pressurisés, serveurs moins saturés, clients mieux servis. L’ingénierie avance au pas de la raison, et ce pas est durable.

Conclusion : deux mondes, une méthode, un même horizon

Au fil des ateliers visités et des plateformes disséquées, une évidence se renforce : l’industrie de pointe et les expériences numériques partagent un squelette méthodologique. On observe, on mesure, on simule, on ajuste, puis on recommence. Cette boucle sobre et tenace fabrique à la fois une aile d’aéronef fiable et une interface confiante, y compris lorsqu’elle se niche dans un univers récréatif où l’exigence technique doit rester discrète.

La digression vers l’univers des jeux en ligne n’a rien d’un pas de côté ; elle illustre une même obsession : concevoir des systèmes justes, agréables et prévisibles. Que l’outil soit un bras robotisé ou un service hébergé, les principes convergent : tolérance aux pannes, clarté des règles, ergonomie éprouvée, métriques utiles et amélioration continue. En embrassant ces leçons croisées, l’écosystème de la 3D-impression, de la robotique, du spatial et des nouveaux matériaux enrichit sa boîte à outils et alimente, par capillarité, des expériences numériques plus nettes, plus sobres et — osons le dire — plus humaines.